HADOOP NEDİR? BÜYÜK VERİ EKOSİSTEMİ

Veri hacmi büyüdükçe klasik yöntemlerle analiz yapmak, depolama maliyetini yönetmek ve farklı kaynaklardan gelen bilgileri anlamlandırmak zorlaşır. Özellikle log kayıtları, kullanıcı hareketleri, sensör verileri, finansal işlemler ve uygulama çıktıları gibi yüksek hacimli akışlar söz konusu olduğunda, tek bir sunucuya dayalı geleneksel yapıların sınırları hızla görünür hale gelir. İşte bu noktada Hadoop, büyük veri dünyasında uzun yıllardır temel referanslardan biri olarak öne çıkar.

Hadoop, büyük miktarda veriyi dağıtık sistemler üzerinde saklamak ve işlemek için geliştirilmiş açık kaynaklı bir ekosistemdir. Onu önemli yapan şey yalnızca çok veriyle çalışabilmesi değildir; aynı zamanda ölçeklenebilirlik, hata toleransı ve maliyet avantajı sunmasıdır. Veri arttığında sistemi tamamen değiştirmek yerine kümeye yeni makineler ekleyerek büyümek mümkündür. Bu yaklaşım, veri mühendisliği ve analitik dünyasında Hadoop’un neden uzun süre merkezi bir konumda kaldığını açıklar.

Bugün büyük veri ekosistemi Spark, Kafka, Hive, HBase ve bulut tabanlı servislerle çok daha geniş bir yapıya dönüşmüş olsa da Hadoop hâlâ kavramsal olarak önemli bir başlangıç noktasıdır. Çünkü dağıtık depolama, paralel işleme, veri yakınlığı ve küme mantığı gibi temel kavramlar büyük ölçüde Hadoop üzerinden anlaşılır. Bu yazıda Hadoop’un ne olduğunu, hangi bileşenlerden oluştuğunu, nerelerde kullanıldığını ve modern veri projelerinde nasıl konumlandığını adım adım inceleyeceğiz.

Hadoop nedir ve neden ortaya çıkmıştır?

Hadoop, büyük veri kümelerini dağıtık biçimde depolamak ve işlemek için tasarlanmış bir yazılım çatısıdır. Açık kaynaklı Apache projesi olarak gelişmiştir ve yatay ölçeklenme mantığıyla çalışır. Yani daha güçlü tek bir makine satın almak yerine, birden fazla sunucudan oluşan bir küme kurarak veri ve iş yükü bu makineler arasında dağıtılır. Bu yapı hem maliyetleri kontrol altında tutar hem de sistemin büyümesini kolaylaştırır.

Hadoop’un ortaya çıkış nedeni, internet ölçeğinde üretilen verinin hızla büyümesidir. Arama motorları, e-ticaret platformları, mobil uygulamalar ve dijital servisler çok büyük miktarda kayıt üretmeye başladığında, klasik ilişkisel veritabanları bu yükü tek başına taşımakta zorlandı. Özellikle yapılandırılmış ve yapılandırılmamış verilerin aynı ortamda saklanması ve işlenmesi ihtiyacı, daha esnek bir çözüm gerektirdi. Hadoop bu ihtiyaca, dağıtık dosya sistemi ve paralel işleme mantığıyla yanıt verdi.

Tek sunuculu yapılardan dağıtık mimariye geçmek

Geleneksel yapılarda veri tek bir sunucuda tutulur ve işlem kapasitesi o sunucunun sınırlarıyla belirlenir. Veri büyüdükçe disk, bellek ve işlemci yetersiz kalabilir. Hadoop ise veriyi birden fazla düğüme böler ve işlemleri bu düğümler arasında dağıtır. Böylece sistem yalnızca daha büyük veri saklamakla kalmaz, aynı zamanda paralel işleyerek zamanı daha verimli kullanır.

Büyük veri problemlerine maliyet odaklı yaklaşmak

Hadoop’un yaygınlaşmasında önemli bir etken de görece uygun maliyetli donanımlarla çalışabilmesidir. Yüksek kapasiteli tekil sistemler yerine standart sunucuların kümelenmesi, büyüme ihtiyacı olan ekipler için daha erişilebilir bir model sundu. Bu sayede veri depolama ve analiz kapasitesi, ihtiyaç arttıkça genişletilebilen esnek bir yapıya kavuştu.

Hadoop ekosisteminin temel bileşenleri nelerdir?

Hadoop denildiğinde çoğu kişi tek bir araç düşünür, ancak gerçekte bu yapı birkaç temel bileşenin birlikte çalışmasıyla anlam kazanır. En bilinen üç ana parça HDFS, YARN ve MapReduce’tur. Zaman içinde Hive, Pig, HBase, Sqoop, Flume ve Oozie gibi araçlar da ekosisteme dâhil olmuş ve Hadoop yalnızca depolama çözümü olmaktan çıkarak daha geniş bir veri platformuna dönüşmüştür.

Bu bileşenlerin her biri farklı bir ihtiyaca cevap verir. Kimi veri depolar, kimi kaynak yönetir, kimi ise analiz süreçlerini çalıştırır. Büyük veri projelerinde asıl değer, bu parçaların birlikte çalışmasından gelir. Veri bir noktadan sisteme alınır, dağıtık ortamda saklanır, iş kurallarına göre işlenir ve ardından raporlama ya da makine öğrenmesi gibi farklı alanlarda kullanılır.

HDFS ile dağıtık dosya sistemi kurmak

HDFS, yani Hadoop Distributed File System, büyük veri dosyalarını küme üzerindeki farklı düğümlere bölerek saklar. Bu sistemin en önemli özelliklerinden biri, veriyi bloklara ayırması ve yedekli biçimde tutmasıdır. Bir makinede sorun yaşansa bile diğer kopyalar sayesinde veri kaybı riski azalır. Bu yapı, hata toleransı açısından kritik avantaj sağlar.

YARN ile kaynakları yönetmek

YARN, küme üzerindeki işlemci ve bellek gibi kaynakların hangi işler tarafından ne kadar kullanılacağını yöneten katmandır. Birden fazla veri işi aynı anda çalıştığında, hangi uygulamanın hangi düğümden kaynak alacağı YARN tarafından planlanır. Böylece kümeyi verimli kullanmak mümkün hale gelir.

MapReduce ile paralel işleme mantığını uygulamak

MapReduce, büyük veri üzerinde paralel işlem yapmayı mümkün kılan programlama modelidir. “Map” aşamasında veri parçalara ayrılır ve işlenir; “Reduce” aşamasında ise bu parçaların çıktıları birleştirilir. Günümüzde Spark gibi daha hızlı araçlar birçok senaryoda öne çıkmış olsa da dağıtık işleme mantığını anlamak için MapReduce hâlâ öğretici bir çerçevedir.

- HDFS: Veriyi dağıtık biçimde depolar

- YARN: Kaynak planlaması ve görev yönetimi sağlar

- MapReduce: Büyük veriyi paralel işleme mantığıyla çalıştırır

- Hive: SQL benzeri sorgulama katmanı sunar

- HBase: Düşük gecikmeli erişim için NoSQL yapı sağlar

HDFS nasıl çalışır ve neden önemlidir?

HDFS’in temel mantığı, büyük dosyaları sabit boyutlu bloklara ayırmak ve bu blokları küme üzerindeki farklı makinelerde saklamaktır. Örneğin çok büyük bir log dosyası tek parça halinde tutulmak yerine bloklara bölünür. Bu bloklar farklı düğümlere yazılır ve her bloktan birden fazla kopya oluşturulur. Böylece hem paralel okuma yapılabilir hem de arıza durumunda verinin diğer kopyalarına erişilebilir.

Bu yapı veri yakınlığı prensibiyle de desteklenir. Yani mümkün olduğunda veri işlem yapılacak yere taşınmak yerine, işlem verinin bulunduğu düğüme yakın bir noktada gerçekleştirilir. Bu yaklaşım ağ trafiğini azaltır ve büyük veri işlerinde performansa katkı sağlar. Özellikle terabaytlarca veri söz konusu olduğunda bu fark pratikte oldukça önemlidir.

NameNode ve DataNode rolleri

HDFS mimarisinde NameNode, dosya sisteminin metadata bilgisini tutar. Hangi dosyanın hangi bloklardan oluştuğu ve bu blokların hangi düğümlerde yer aldığı gibi kritik bilgiler burada yönetilir. DataNode’lar ise gerçek veri bloklarını saklayan düğümlerdir. Sistemin birlikte çalışabilmesi için bu iki rolün sağlıklı koordinasyonu gerekir.

Replikasyon mantığıyla veri güvenliğini artırmak

Bir veri bloğunun birden fazla kopyasının farklı makinelerde bulunması, Hadoop’un dayanıklılık gücünü artırır. Donanım arızaları, disk sorunları veya ağ kesintileri dağıtık ortamlarda kaçınılmaz olabilir. HDFS bu riskleri tasarım seviyesinde kabul eder ve veriyi çoğaltarak hizmet sürekliliğini korumaya çalışır. Bu nedenle Hadoop altyapısı, büyük veri operasyonlarında güven veren bir seçenek haline gelir.

hdfs dfs -mkdir /logs

hdfs dfs -put application.log /logs

hdfs dfs -ls /logs

hdfs dfs -cat /logs/application.logBu örnek, HDFS üzerinde klasör oluşturma, dosya yükleme ve içerik görüntüleme gibi temel işlemleri gösterir. Pratikte veri mühendisleri, log dosyalarını, CSV çıktılarını veya işlenmiş veri setlerini HDFS üzerinde benzer komutlarla yönetir. Bu seviyedeki işlemler, dağıtık depolama mantığını somut biçimde anlamak için oldukça değerlidir.

MapReduce mantığı büyük veri işlemede nasıl kullanılır?

MapReduce, büyük bir veri işini daha küçük görevlere bölerek paralel biçimde çalıştırma yaklaşımıdır. Sistem önce veriyi parçalara ayırır, her parça üzerinde aynı işlemi uygular ve ardından sonuçları toplar. Bu yöntem, özellikle çok büyük veri setlerinde toplu analiz işleri için uygundur. Log analizi, kelime sayımı, kategori bazlı özet çıkarma ve toplu istatistik üretimi gibi işlemler bu modele güzel örnekler sunar.

MapReduce bugün her projede doğrudan kullanılmasa da dağıtık düşünme biçimini anlamak açısından önemlidir. Çünkü veri tek parça halinde işlenmez; farklı parçalara bölünür, bağımsız olarak işlenir ve sonra ortak çıktı üretilir. Bu düşünme biçimi, modern veri araçlarında da yaşamaya devam eder.

Map aşamasında veri parçalara ayrılır

Map kısmında sistem girdiyi satır, kayıt veya blok düzeyinde ele alır. Her kayıt için belirli bir dönüşüm yapılır ve ara çıktı üretilir. Örneğin web sunucusu loglarındaki durum kodlarını saymak istiyorsanız, her satırdan durum kodu alınır ve eşleşen değer için bir sayaç çıktısı oluşturulur.

Reduce aşamasında sonuçlar birleştirilir

Reduce aşaması, benzer anahtarları bir araya getirir ve toplu sonuç üretir. Bu sayede milyonlarca satırlık veri içinden özet bilgi çıkarılabilir. Paralel işleme mantığı burada verimlilik kazandırır; çünkü verinin tamamı tek bir noktada sırayla işlenmek zorunda kalmaz.

map(String logLine):

statusCode = extractStatusCode(logLine)

emit(statusCode, 1)

reduce(String statusCode, List counts):

total = sum(counts)

emit(statusCode, total)Bu yalın örnek, log kayıtlarındaki HTTP durum kodlarının kaç kez geçtiğini sayan bir MapReduce akışını gösterir. Gerçek projelerde çok daha karmaşık senaryolar görülebilir; ancak temel mantık değişmez. Veri önce parçalanır, sonra işlenir ve en sonunda toplulaştırılır.

Hive, HBase ve diğer araçlar Hadoop ekosistemini nasıl genişletir?

Hadoop’un yaygın benimsenmesinde yalnızca çekirdek bileşenler etkili olmadı. Asıl sıçrama, veriyle çalışan farklı rollerin bu sisteme daha rahat erişebilmesini sağlayan araçlarla gerçekleşti. SQL bilen analistlerin Hive kullanarak sorgu yazabilmesi, veri akışlarının Flume veya Sqoop ile sisteme alınabilmesi ve düşük gecikmeli erişim ihtiyacının HBase ile karşılanabilmesi, Hadoop’u daha işlevsel hale getirdi.

Bu araçlar sayesinde Hadoop yalnızca geliştiricilerin veya sistem yöneticilerinin alanı olmaktan çıktı. Analistler, veri mühendisleri ve platform ekipleri ortak bir veri altyapısı üzerinde çalışabildi. Özellikle veri ambarı benzeri sorgulama ihtiyaçları ile büyük ölçekli ham veri saklama ihtiyacı bir araya geldiğinde, bu yapı daha anlamlı hale geldi.

Hive ile SQL benzeri sorgulama yapmak

Hive, HDFS üzerinde tutulan verileri tablo mantığıyla sorgulamayı kolaylaştırır. SQL’e benzeyen HiveQL dili sayesinde veriyle çalışan ekipler, düşük seviyeli MapReduce kodu yazmadan analiz yapabilir. Bu yaklaşım öğrenme eşiğini azaltır ve raporlama süreçlerini hızlandırır.

HBase ile hızlı erişim senaryolarını desteklemek

HBase, kolon odaklı bir NoSQL veritabanı olarak Hadoop ekosisteminde konumlanır. Çok büyük veri setlerinde satır bazlı hızlı erişim gereken durumlarda tercih edilebilir. Örneğin zaman serisi verileri, kullanıcı profilleri veya düşük gecikmeli okuma gerektiren bazı uygulamalar için uygun olabilir. Ancak her senaryoda ilişkisel veritabanlarının yerine geçmesi beklenmemelidir.

Veri taşıma ve entegrasyon süreçlerini kolaylaştırmak

Sqoop ilişkisel veritabanları ile Hadoop arasında veri taşıma için kullanılırken, Flume log ve akış verilerinin sisteme alınmasında öne çıkar. Bu araçlar veri gölüne bilgi akışını düzenler ve veri işleme boru hatlarının kurulmasını kolaylaştırır. Böylece Hadoop, izole bir sistem olmaktan çıkar ve daha geniş veri entegrasyonu süreçlerine bağlanır.

Hadoop hangi kullanım alanlarında öne çıkar?

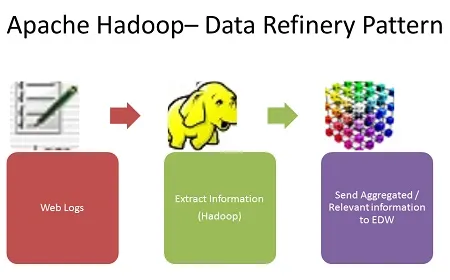

Hadoop en çok yüksek hacimli, çeşitli ve sürekli büyüyen verilerin işlendiği senaryolarda öne çıkar. Uygulama logları, tıklama verileri, IoT kayıtları, telekom verileri, işlem geçmişleri ve makine çıktıları gibi kaynaklar bu kapsama girer. Özellikle verinin önce ekonomik biçimde saklanması, sonra toplu analizler için işlenmesi gerekiyorsa Hadoop güçlü bir seçenek olabilir.

Veri gölü yaklaşımının yaygınlaşmasında da Hadoop önemli rol oynadı. Farklı formatlarda gelen verilerin tek bir merkezi ortamda tutulması, daha sonra iş kurallarına göre dönüştürülmesi ve analitik süreçlere hazırlanması bu yapıyla daha erişilebilir hale geldi. Her ne kadar bulut tabanlı servisler bugün benzer ihtiyaçları daha yönetilebilir şekilde sunabilse de kavramsal temel büyük ölçüde Hadoop yaklaşımına dayanır.

Log analizi ve davranış verisi işlemek

Web uygulamaları, mobil servisler ve API platformları sürekli log üretir. Bu loglar performans izleme, hata analizi, güvenlik kontrolleri ve kullanıcı davranışı incelemeleri için değerlidir. Hadoop, bu büyük dosya kümelerini depolamak ve toplu işleme senaryolarında değerlendirmek için uzun süre önemli bir tercih olmuştur.

Arşivleme ve uzun vadeli veri saklamak

Her veri gerçek zamanlı sorgu için tutulmaz. Bazı senaryolarda verinin uzun süre ekonomik şekilde saklanması ve gerektiğinde işlenmesi yeterlidir. Hadoop, ölçeklenebilir depolama mantığı sayesinde bu tür ihtiyaçlarda anlamlı bir rol üstlenebilir. Özellikle geçmişe dönük analiz, karşılaştırmalı raporlama ve model eğitimi öncesi hazırlık aşamalarında fayda sağlar.

Modern veri dünyasında Hadoop’un yeri nasıl değişti?

Bugün veri dünyasında bulut servisleri, yönetilen veri platformları ve gerçek zamanlı işleme araçları çok daha görünür durumda. Spark, Kafka, Delta Lake, Snowflake, BigQuery ve benzeri çözümler, birçok senaryoda daha hızlı geliştirme ve daha kolay operasyon imkânı sunuyor. Buna rağmen Hadoop’un önemi tamamen ortadan kalkmış değildir. Çünkü dağıtık veri işleme mantığını, veri gölü yaklaşımını ve küme tabanlı çalışma modelini anlamak için hâlâ güçlü bir referanstır.

Ayrıca birçok büyük ölçekli yapıda Hadoop tabanlı sistemler tamamen kaldırılmış değildir. Bazı organizasyonlarda eski veri gölü yapıları, on-premise kümeler veya hibrit mimariler hâlâ aktif biçimde çalışır. Bu nedenle Hadoop bilgisi yalnızca tarihsel bir konu değildir; veri altyapısı dönüşüm projelerinde ve geçiş planlarında da değerlidir.

Spark ile ilişkisi nasıl değerlendirilir?

Spark çoğu zaman Hadoop’un alternatifi gibi konuşulsa da aslında birçok senaryoda onunla birlikte kullanılabilir. Spark, HDFS üzerinde tutulan veriyi okuyabilir ve YARN üzerinden çalıştırılabilir. Aralarındaki temel fark, Spark’ın bellek içi işleme yaklaşımı sayesinde çok daha hızlı analitik akışlar sunabilmesidir. Yine de Hadoop’un depolama ve küme yaklaşımı, Spark tabanlı çözümlerde bile kavramsal önemini korur.

Bulut ortamlarında Hadoop bilgisi neden hâlâ değerlidir?

Yönetilen servisler operasyon yükünü azaltıyor olsa da verinin dağıtık olarak nasıl saklandığını, işlerin nasıl planlandığını ve kaynakların nasıl kullanıldığını anlamak önemini korur. Büyük veri ekosistemi içinde çalışan ekipler için Hadoop bilgisi, yalnızca belirli bir aracı öğrenmek değil; aynı zamanda veri platformlarının temel davranış biçimini kavramaktır.

Hadoop öğrenmek isteyen ekipler hangi konulara odaklanmalı?

Hadoop öğrenirken yalnızca komut ezberlemek yeterli olmaz. Önce büyük veri problemi doğru tanımlanmalıdır: Neden dağıtık depolama gerekir, veri neden bloklara ayrılır, paralel işleme neden avantaj sağlar ve hangi senaryoda hangi araç öne çıkar? Bu temel sorular netleştiğinde teknik bileşenler çok daha anlamlı hale gelir.

Ardından Linux temelleri, dosya sistemi mantığı, veri formatları, SQL bilgisi ve veri modelleme yaklaşımı gibi destekleyici konular üzerinde durmak gerekir. Çünkü Hadoop tek başına bir hedef değil, daha geniş veri mühendisliği dünyasının bir bileşenidir. Öğrenme sürecini daha sistemli hale getirmek isteyenler için data engineering eğitimi iyi bir çerçeve sunabilir.

Dağıtık sistem mantığını kavramak

Bir işin neden tek makinede değil küme üzerinde çalıştırıldığını anlamak, Hadoop öğrenmenin merkezindedir. Veri yerelliği, yedeklilik, görev zamanlama ve hata toleransı gibi kavramlar sindirilmeden yapılan teknik çalışma yüzeyde kalır. Bu nedenle önce mantığı, sonra araçları öğrenmek daha kalıcı sonuç verir.

Veri boru hatlarıyla ilişki kurmak

Hadoop çoğu zaman veri alma, dönüştürme, saklama ve analiz etme süreçlerinin yalnızca bir bölümünde yer alır. Bu yüzden ETL/ELT mantığı, toplu işleme akışları, dosya formatları ve veri kalitesi kontrolleriyle birlikte değerlendirilmelidir. Böylece teknoloji tek başına değil, iş akışının parçası olarak anlaşılır.

Sonuç olarak Hadoop, büyük veri dünyasını anlamak için en önemli kavramlardan birini temsil eder. Dağıtık depolama, paralel işleme, hata toleransı ve ölçeklenebilirlik gibi başlıklar, modern veri platformlarının temel yapı taşlarıdır. Bugün kullanılan araçlar çeşitlenmiş ve kullanıcı deneyimi açısından daha gelişmiş çözümler ortaya çıkmış olsa da Hadoop bu dönüşümün altyapısını oluşturan düşünce biçimini güçlü şekilde temsil etmeye devam eder. Veriyi büyüyen bir yük olarak değil, doğru mimariyle yönetilebilen stratejik bir kaynak olarak görmek isteyen ekipler için Hadoop bilgisi hâlâ değerli bir başlangıçtır.