DATA ENGİNEERİNG NEDİR? VERİ BORU HATLARI VE MODERN VERİ ALTYAPISI

Veri artık yalnızca raporlama ekiplerinin kullandığı teknik bir kaynak değil; ürün geliştirmeden pazarlamaya, operasyon yönetiminden finansal planlamaya kadar birçok kararın temel girdisi hâline geldi. Ancak verinin gerçekten değer üretmesi, farklı sistemlerde dağınık duran kayıtların anlamlı, güvenilir ve erişilebilir bir yapıya dönüştürülmesine bağlıdır. İşte bu dönüşümün arkasındaki disiplin data engineering olarak adlandırılır.

Bugün birçok ekip, veriye ulaşamadığı için değil; doğru, güncel ve tutarlı veriye sürdürülebilir şekilde erişemediği için zorlanıyor. CRM kayıtları bir yerde, uygulama logları başka bir yerde, analitik olaylar başka bir platformda tutuluyor. Bu kaynakları bir araya getirmek, temizlemek, taşımak, dönüştürmek ve doğru kişilere doğru formatta sunmak ise güçlü bir veri mühendisliği yaklaşımı gerektiriyor.

Bu yazıda data engineering nedir sorusunu temelden başlayarak ele alacağız. Veri boru hatlarının nasıl çalıştığını, modern veri altyapısının hangi bileşenlerden oluştuğunu, hangi araçların neden tercih edildiğini ve bu alanın neden giderek daha kritik hâle geldiğini detaylı biçimde inceleyeceğiz. Ayrıca konuya daha sistemli yaklaşmak isteyenler için data engineering eğitimi bağlantısını da değerlendirebilirsiniz.

Data Engineering Kavramını Temelden Anlamak

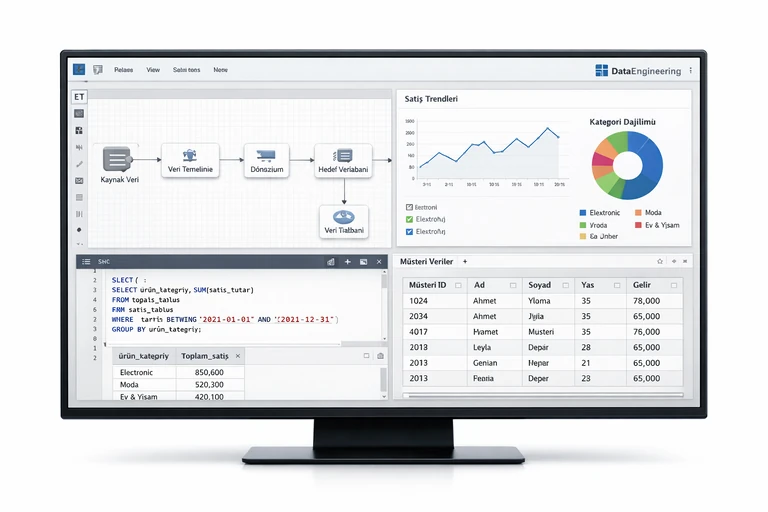

Data engineering, farklı kaynaklardan gelen veriyi toplama, taşıma, dönüştürme, saklama ve kullanıma hazır hâle getirme süreçlerinin tasarlanması ve işletilmesidir. Bu alanın amacı yalnızca veriyi bir noktadan başka bir noktaya taşımak değildir; aynı zamanda verinin kaliteli, izlenebilir, güvenli ve tekrar kullanılabilir olmasını sağlamaktır.

Veri mühendisliği çoğu zaman veri analitiği, veri bilimi ve iş zekâsı ile karıştırılır. Oysa veri mühendisleri, bu alanların verimli çalışabilmesi için gerekli zemini hazırlar. Başka bir ifadeyle, raporların doğru sonuç vermesi, makine öğrenmesi modellerinin güvenilir veriyle beslenmesi ve dashboard'ların gecikmesiz çalışması büyük ölçüde veri mühendisliği kalitesine bağlıdır.

Veri mühendisliği ile veri analitiği arasındaki farkı görmek

Veri analitiği, mevcut veriden içgörü üretmeye odaklanırken veri mühendisliği bu verinin erişilebilir ve güvenilir olmasını sağlar. Analistler genellikle sorgular, dashboard'lar ve metrikler üzerinde çalışır; veri mühendisleri ise bu yapıların beslendiği veri akışını kurar. Bu nedenle veri mühendisliği, analitiğin görünmeyen ama kritik temelidir.

Ham veriyi kullanılabilir veri ürününe dönüştürmek

Bir uygulamadan gelen ham olay kayıtları, çoğu zaman doğrudan raporlamaya uygun değildir. Eksik alanlar, yinelenen kayıtlar, farklı zaman damgaları veya tutarsız kullanıcı kimlikleri sorun yaratır. Veri mühendisliği süreci, bu ham veriyi temizleyerek standartlaştırır ve raporlama ya da modelleme için kullanılabilir bir formata dönüştürür.

Veri Boru Hatları Nasıl Çalışır?

Veri boru hatları, verinin kaynaktan hedef sisteme belirli adımlar üzerinden aktığı otomasyon süreçleridir. Bu hatlar batch ya da streaming mantığıyla çalışabilir. Amaç; veriyi manuel müdahaleye ihtiyaç duymadan düzenli, güvenilir ve gözlemlenebilir biçimde taşımaktır. Modern ekipler için veri boru hatları, günlük operasyonların omurgası sayılır.

Bir veri boru hattı genellikle veri alımı, dönüştürme, doğrulama, saklama ve servis etme adımlarından oluşur. Bazı yapılarda veri önce veri gölüne alınır, ardından dönüşüm katmanından geçerek veri ambarına yüklenir. Bazı yapılarda ise olaylar gerçek zamanlı işlendiği için daha düşük gecikmeli platformlar kullanılır.

Kaynak sistemlerden veri toplamak

Veri; ilişkisel veritabanları, SaaS uygulamaları, log servisleri, mobil uygulamalar, API'ler ve dosya sistemleri gibi çok farklı kaynaklardan gelebilir. Bu nedenle veri toplama katmanının esnek olması gerekir. Kaynağın yapısına göre CDC, webhook, event streaming veya zamanlanmış export yöntemleri tercih edilebilir.

Dönüştürme ve veri modelleme süreçlerini tasarlamak

Toplanan verinin hedef kullanım senaryosuna göre dönüştürülmesi gerekir. Bu aşamada alan adları standardize edilir, tarih formatları düzeltilir, iş kurallarına göre yeni metrikler üretilir ve boyutsal modelleme yapılır. Özellikle analitik ekiplerde ELT yaklaşımı, yani veriyi önce yükleyip ardından dönüşümleri veri ambarı üzerinde yapmak oldukça yaygındır.

Doğrulama, izleme ve hata yönetimini kurgulamak

Bir veri boru hattı yalnızca çalışıyor olmasıyla başarılı sayılmaz. Eksik veri yüklüyorsa, şema değişikliklerini algılamıyorsa veya gecikmeleri raporlamıyorsa zamanla güven kaybı oluşur. Bu yüzden veri kalitesi testleri, pipeline monitoring, alert mekanizmaları ve lineage takibi modern mimarinin vazgeçilmez parçalarıdır.

from datetime import datetime

from airflow import DAG

from airflow.operators.python import PythonOperator

def extract_orders():

print("Orders extracted from source system")

def transform_orders():

print("Null values cleaned, timestamps normalized")

def load_orders():

print("Orders loaded into analytics warehouse")

with DAG(

dag_id="orders_etl_pipeline",

start_date=datetime(2026, 1, 1),

schedule="@daily",

catchup=False

) as dag:

extract = PythonOperator(task_id="extract", python_callable=extract_orders)

transform = PythonOperator(task_id="transform", python_callable=transform_orders)

load = PythonOperator(task_id="load", python_callable=load_orders)

extract >> transform >> load

Yukarıdaki örnek, günlük çalışan basit bir ETL akışını gösterir. Gerçek hayatta bu akışın içine veri kalitesi kontrolleri, hata tekrar denemeleri, bildirim kuralları ve sürüm takibi de eklenir. Yani veri boru hattı yalnızca koddan değil, aynı zamanda operasyonel disiplinden oluşur.

Modern Veri Altyapısı Hangi Bileşenlerden Oluşur?

Modern veri altyapısı, geçmişteki tek parça ve kapalı sistemlerden farklı olarak modüler, bulut tabanlı ve API odaklı araçların birlikte çalıştığı bir yapıyı ifade eder. Bu yaklaşım sayesinde ekipler, ihtiyaç duydukları bileşenleri ayrı ayrı seçebilir ve daha esnek ölçeklenebilir mimariler kurabilir.

Bu altyapının temel bileşenleri arasında veri kaynakları, ingestion katmanı, veri gölü veya veri ambarı, dönüşüm araçları, orkestrasyon katmanı, veri kalitesi çözümleri, katalog ve yönetişim araçları bulunur. İyi tasarlanmış bir mimari, yalnızca bugünkü rapor ihtiyaçlarını değil gelecekteki analitik ve yapay zekâ senaryolarını da destekler.

Veri gölü ve veri ambarı kullanımını konumlandırmak

Veri gölü, ham ve yarı yapılandırılmış verilerin büyük ölçekli biçimde saklanmasına uygun bir katmandır. Veri ambarı ise analitik sorgular, dashboard'lar ve metrik üretimi için optimize edilmiş daha yapılandırılmış bir alandır. Modern yapılarda bu iki katman bazen birlikte, bazen de lakehouse yaklaşımıyla tek mantık altında kullanılabilir.

Orkestrasyon ve zamanlamayı merkezi şekilde yönetmek

Birden fazla veri akışı olduğunda, hangi işin ne zaman başlayacağı ve hangi koşulda başarısız sayılacağı merkezi olarak yönetilmelidir. Airflow, Dagster ve benzeri araçlar bu noktada önem kazanır. Orkestrasyon katmanı, bağımlılıkların takibini kolaylaştırır ve bakım maliyetini düşürür.

Metadata, lineage ve veri yönetişimini görünür kılmak

Verinin nereden geldiği, hangi dönüşümlerden geçtiği ve hangi raporları etkilediği bilinmiyorsa ölçeklenebilirlik zayıflar. Metadata yönetimi ve lineage takibi, özellikle bir alandaki değişikliğin diğer alanlara etkisini görmek açısından büyük değer taşır. Bu görünürlük, veri ekipleri ile iş ekipleri arasındaki güveni de artırır.

- Kaynak sistemlerin envanterini çıkarmak

- Veri sahipliğini ve sorumluluk alanlarını tanımlamak

- Şema değişikliklerini izlemek ve duyurmak

- Kalite testlerini otomatikleştirmek

- Erişim yetkilerini veri hassasiyetine göre düzenlemek

ETL, ELT ve Gerçek Zamanlı Veri İşleme Yaklaşımları

Veri mühendisliğinde en sık konuşulan konulardan biri, verinin ne zaman ve nerede dönüştürüleceğidir. Geleneksel ETL yaklaşımında veri önce çıkarılır, sonra dönüştürülür ve son olarak hedef sisteme yüklenir. ELT yaklaşımında ise veri önce hedef depolama katmanına alınır, dönüşümler burada gerçekleştirilir. Bulut veri ambarlarının güçlenmesiyle birlikte ELT giderek daha fazla tercih edilmektedir.

Bunun yanında bazı senaryolar gerçek zamanlı veri işleme gerektirir. Örneğin kullanıcı davranışlarını anlık analiz etmek, sahtekârlık sinyallerini hızla yakalamak veya operasyonel metrikleri gecikmesiz izlemek için streaming tabanlı mimariler kullanılır. Bu noktada Kafka, Flink, Spark Structured Streaming ve benzeri çözümler devreye girebilir.

Batch işleme ve düşük maliyetli senaryoları planlamak

Her veri problemi gerçek zamanlı çözüm gerektirmez. Günlük satış raporu, haftalık pazarlama analizi veya aylık finans kapanışı gibi birçok senaryo için batch işleme yeterlidir. Doğru yerde batch kullanmak, maliyetleri düşürür ve mimarinin gereksiz karmaşıklaşmasını önler.

Streaming mimarilerle düşük gecikmeli veri akışı kurmak

Gerçek zamanlı veri işleme, olayların oluştuğu anda işlenmesine odaklanır. Burada gecikme yalnızca performans konusu değildir; bazen iş değeri doğrudan gecikmeyle ilişkilidir. Anlık öneri sistemleri, canlı gösterge panelleri ve operasyonel uyarılar bu yapının yaygın kullanım alanları arasındadır.

SELECT

DATE_TRUNC('day', event_time) AS event_day,

country_code,

COUNT(*) AS total_events,

COUNT(DISTINCT user_id) AS unique_users

FROM raw_app_events

WHERE event_time >= CURRENT_DATE - INTERVAL '7 day'

AND event_name = 'purchase_completed'

GROUP BY 1, 2

ORDER BY event_day DESC, total_events DESC;

Bu örnek sorgu, ham olay tablosundan son yedi gün içindeki satın alma tamamlanma verisini özetler. Uygulamada bu tip sorgular çoğunlukla doğrudan ham tablolar üzerinde değil, veri mühendisliği tarafından modellenmiş ara katmanlar ve güvenilir metrik tabanları üzerinden çalıştırılır.

Data Engineering Sürecinde Kullanılan Temel Araçlar

Data engineering ekosistemi oldukça geniştir. Ancak araç seçiminin modaya göre değil, veri hacmi, ekip yetkinliği, entegrasyon ihtiyacı, bakım maliyeti ve güvenlik beklentilerine göre yapılması gerekir. Aynı probleme farklı araçlarla çözüm üretilebilir; önemli olan uzun vadeli işletilebilirliktir.

Örneğin veri taşıma katmanında Fivetran, Airbyte veya özel geliştirilmiş connector'lar tercih edilebilir. Dönüşüm katmanında dbt öne çıkarken, orkestrasyonda Airflow ve Dagster sık kullanılır. Depolama tarafında BigQuery, Snowflake, Redshift veya Databricks gibi platformlar devreye girer. İzleme ve kalite tarafında ise Great Expectations, Monte Carlo veya açık kaynaklı farklı çözümler değerlendirilebilir.

Açık kaynak ve yönetilen servis tercihlerini dengelemek

Açık kaynak çözümler esneklik ve özelleştirme avantajı sağlar; yönetilen servisler ise operasyonel yükü azaltır. Küçük ekiplerde yönetilen servisler hız kazandırabilirken, daha büyük yapılarda açık kaynak tabanlı çözümler maliyet ve kontrol dengesi açısından öne çıkabilir. Karar verirken sadece lisans maliyeti değil bakım ve uzmanlık ihtiyacı da düşünülmelidir.

Bulut veri platformlarını kullanım senaryolarına göre seçmek

Bulut platformları arasında seçim yaparken sorgu performansı, depolama modeli, eşzamanlı kullanıcı desteği, veri paylaşımı özellikleri ve ekosistem uyumu gibi başlıklar önemlidir. Her platformun güçlü olduğu alan farklıdır. Dolayısıyla teknoloji kararı, iş hedefleri ve veri kullanım biçimiyle birlikte ele alınmalıdır.

Veri Kalitesi, Güvenlik ve Sürdürülebilirlik Neden Kritik?

Bir veri altyapısı yalnızca hızlı çalıştığı için başarılı sayılmaz. Verinin doğru olmaması, eksik yüklenmesi veya yanlış kişilere açılması çok daha büyük riskler doğurur. Bu nedenle veri mühendisliğinde kalite, güvenlik ve sürdürülebilirlik temel prensipler olarak ele alınmalıdır.

Veri kalitesi tarafında beklenen değer aralıkları, boş alan oranları, birincil anahtar tekrarları ve güncellik kontrolleri düzenli olarak izlenmelidir. Güvenlik tarafında ise erişim politikaları, maskeleme kuralları, denetim logları ve hassas veri sınıflandırması devreye girer. Sürdürülebilirlik açısından da dokümantasyon, kod standartları ve test otomasyonu kritik rol oynar.

Veri kalite testlerini otomatikleştirerek güven oluşturmak

Manuel kontrolle yürütülen veri doğrulama süreçleri ölçeklenmez. Bu nedenle tablo bazlı testler, sütun kuralları, referans bütünlüğü kontrolleri ve anomali tespiti otomatikleştirilmelidir. Böylece sorunlar raporlara yansımadan önce fark edilir ve veri tüketicilerinin güveni korunur.

Erişim yönetimi ve hassas veri korumasını uygulamak

Her ekip üyesinin her veriye erişmesi doğru değildir. Yetki modeli, iş ihtiyacına göre kurgulanmalı; kişisel veriler için ek koruma katmanları oluşturulmalıdır. Özellikle müşteri verileri, finans kayıtları ve kullanıcı davranışı gibi alanlarda güvenlik politikalarının veri mimarisine gömülü olması gerekir.

Data Engineer Rolü, Yetkinlikleri ve Eğitim İhtiyacı

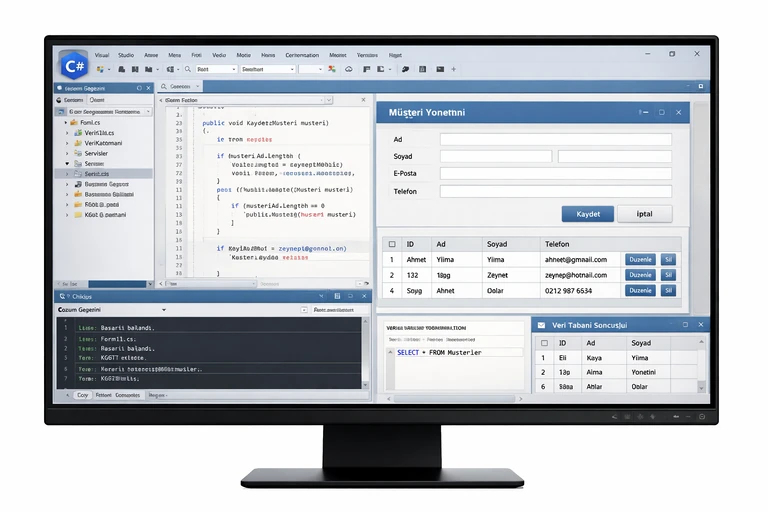

Data engineer rolü, sadece veri taşıyan kişi olarak düşünülmemelidir. Bu rol; sistem tasarımı, performans optimizasyonu, veri modelleme, otomasyon, gözlemlenebilirlik ve ekipler arası koordinasyon gibi birçok beceriyi bir araya getirir. Bu nedenle iyi bir veri mühendisi, hem yazılım geliştirme prensiplerine hem de veri yaşam döngüsüne hâkim olmalıdır.

Temel yetkinlikler arasında SQL, Python, veri modelleme, bulut servisleri, dağıtık sistem mantığı, API kullanımı ve iş akışı orkestrasyonu yer alır. Bunun yanında iletişim becerisi de önemlidir; çünkü veri mühendisleri yalnızca teknik sistemlerle değil, veri tüketen ekiplerle de sürekli temas hâlindedir.

Teknik becerileri proje bağlamında geliştirmek

Salt araç bilgisi çoğu zaman yeterli olmaz. Asıl değer, bir problemin veri akışına nasıl dönüştürüleceğini anlayabilmektir. Bu yüzden eğitim süreci; SQL yazmaktan çok veri modelleme düşüncesi, pipeline tasarımı, hata yönetimi ve performans optimizasyonu gibi başlıkları da içermelidir.

Eğitim yatırımıyla ortak dil ve üretim standardı oluşturmak

Veri altyapısında en sık yaşanan sorunlardan biri, ekiplerin aynı konuyu farklı şekillerde ele almasıdır. Ortak bir yaklaşım geliştirildiğinde kod kalitesi artar, dokümantasyon güçlenir ve teslim süreleri kısalır. Bu nedenle yapılandırılmış bir öğrenme süreci, teknik kazanımın yanında ekip standardizasyonu da sağlar.

Modern Veri Altyapısına Geçişte Sık Yapılan Hatalar

Birçok ekip yeni araçlar kullanmaya başladığında veri problemlerinin kendiliğinden çözüleceğini düşünür. Oysa teknoloji seçimi kadar mimari disiplin, sahiplik modeli ve bakım yaklaşımı da önemlidir. Modern veri altyapısı kurmak, yalnızca yeni platform satın almak anlamına gelmez; süreçleri yeniden düşünmeyi de gerektirir.

En yaygın hatalardan biri, veri kaynaklarını yeterince anlamadan boru hattı kurmaktır. Bir diğer hata ise veri kalitesi kontrollerini sona bırakmaktır. Ayrıca her problemi gerçek zamanlı çözmeye çalışmak, gereksiz karmaşıklık ve maliyet yaratabilir. Başarılı geçiş için küçük ama güvenilir adımlarla ilerlemek çok daha etkili olur.

Mimariyi araç listesinden ibaret sanmak

Bir veri platformunun güçlü görünmesi, onun iyi tasarlandığı anlamına gelmez. Eğer sahiplik belli değilse, veri sözlüğü yoksa ve hata senaryoları tanımlanmamışsa en modern araçlar bile kısa sürede sorun üretir. Mimari; teknoloji, süreç ve sorumluluk üçlüsünün birlikte çalışmasıyla oluşur.

Dokümantasyon ve veri sözlüğünü ihmal etmek

Bir metriğin nasıl hesaplandığı, bir alanın ne anlama geldiği veya bir tablonun hangi sıklıkla güncellendiği bilinmiyorsa veri kullanım hızı düşer. Bu nedenle veri sözlüğü, lineage açıklamaları ve operasyonel runbook'lar uzun vadeli başarının önemli parçalarıdır.

Özetle data engineering, veriyi yalnızca taşıyan değil; onu işlenebilir, güvenilir ve ölçeklenebilir hâle getiren stratejik bir disiplindir. Veri boru hatları bu disiplinin operasyonel yapısını oluştururken modern veri altyapısı da bu akışların sürdürülebilir biçimde çalışmasını sağlar. Doğru tasarlanmış bir yaklaşım, analitik üretkenliği artırır, karar kalitesini yükseltir ve veri odaklı çalışmayı gerçek anlamda mümkün kılar.

Bu alanda yetkinlik kazanmak isteyen ekipler için temel kavramları anlamanın ötesine geçmek, gerçek senaryolar üzerinden düşünmek ve standart bir uygulama yaklaşımı geliştirmek önemlidir. Özellikle veri mimarisi, ETL/ELT tasarımı, kalite kontrolleri ve bulut veri platformları konusunda derinleşmek uzun vadede önemli avantaj sağlar.