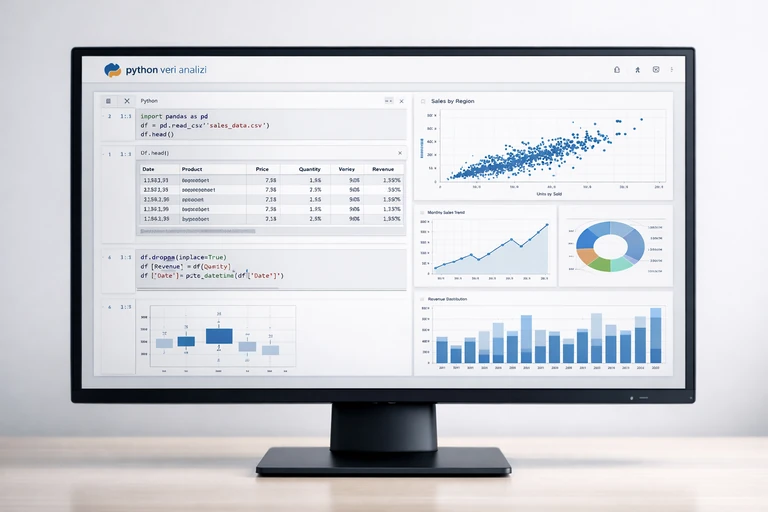

PYTHON İLE VERİ ANALİZİ NEDİR? VERİ BİLİMİ ARAÇLARI

Veri artık yalnızca raporlama ekiplerinin ilgilendiği teknik bir çıktı değil; karar alma süreçlerini, operasyonel verimliliği ve ürün geliştirme yönünü belirleyen stratejik bir kaynak haline geldi. Ancak verinin çok olması tek başına anlam üretmez. Asıl değer, dağınık tabloları düzenli hale getirebilmek, sayılar arasındaki ilişkileri görebilmek ve sonuçları iş kararlarına dönüştürebilmektir. İşte Python ile veri analizi tam olarak bu noktada öne çıkar.

Python, öğrenme eşiği görece düşük, geniş kütüphane desteğine sahip ve veri odaklı çalışmalarda güçlü sonuçlar veren bir programlama dilidir. Veri temizleme, dönüştürme, görselleştirme, istatistiksel inceleme ve otomasyon gibi birçok adım tek bir ekosistem içinde ele alınabilir. Bu sayede farklı ekipler, yalnızca rapor üretmekle kalmaz; aynı zamanda daha hızlı soru sorabilir, hipotez test edebilir ve veri odaklı karar alma kültürünü güçlendirebilir.

Bu yazıda Python ile veri analizinin ne olduğunu, hangi araçlarla çalışıldığını, hangi becerilerin öne çıktığını ve veri bilimi araçlarının neden bu kadar önemli hale geldiğini ayrıntılı biçimde ele alacağız. Ayrıca veri temizleme, keşifsel analiz, görselleştirme ve otomasyon gibi başlıklara değinerek, Python’ın günlük iş akışlarında nasıl pratik bir değer ürettiğini somut örneklerle açıklayacağız.

Python ile veri analizi ne anlama gelir?

Python ile veri analizi, farklı kaynaklardan gelen veriyi toplama, düzenleme, temizleme, inceleme ve anlamlı sonuçlara dönüştürme sürecinin Python diliyle yürütülmesidir. Bu süreçte Excel dosyaları, CSV tabloları, veritabanı kayıtları, API çıktıları veya log verileri gibi birçok kaynak kullanılabilir. Amaç yalnızca sayıları yan yana koymak değildir; verinin içindeki örüntüleri fark etmek, sorunlu kayıtları ayıklamak ve karar vericilerin kullanabileceği içgörüler üretmektir.

Burada önemli olan nokta, veri analizinin tek adımlı bir işlem olmamasıdır. Bir veri seti çoğu zaman ham haliyle analize hazır gelmez. Eksik değerler, tutarsız tarih formatları, mükerrer satırlar, yanlış veri tipleri ve anlamsız kategoriler analiz kalitesini düşürür. Python bu sorunları sistematik biçimde çözmeye yardımcı olur. Böylece tekrar eden işleri otomatikleştirmek, standart veri işleme akışları kurmak ve analiz süreçlerini yeniden üretilebilir hale getirmek mümkün olur.

Veriyi yalnızca okumak değil anlamlandırmak

Bir tabloyu açıp toplam almak veri analizi değildir; bu yalnızca veriye bakmaktır. Asıl analiz, satışın neden düştüğünü, hangi müşteri grubunun daha yüksek dönüşüm sağladığını veya hangi ürünlerin birlikte tercih edildiğini ortaya çıkarmaktır. Python, bu sorguları teknik olarak destekleyen esnek bir çalışma alanı sunar.

Tekrarlanabilir analiz süreçleri kurmak

Elle yapılan analizler kısa vadede hızlı görünse de sürdürülebilir değildir. Her ay aynı raporu yeniden hazırlamak, aynı veri temizleme adımlarını manuel olarak uygulamak zaman kaybına yol açar. Python sayesinde bu adımlar kodlaştırılır ve tekrar eden süreçler daha kontrollü biçimde yönetilir. Bu da veri analizi çalışmalarını daha güvenilir hale getirir.

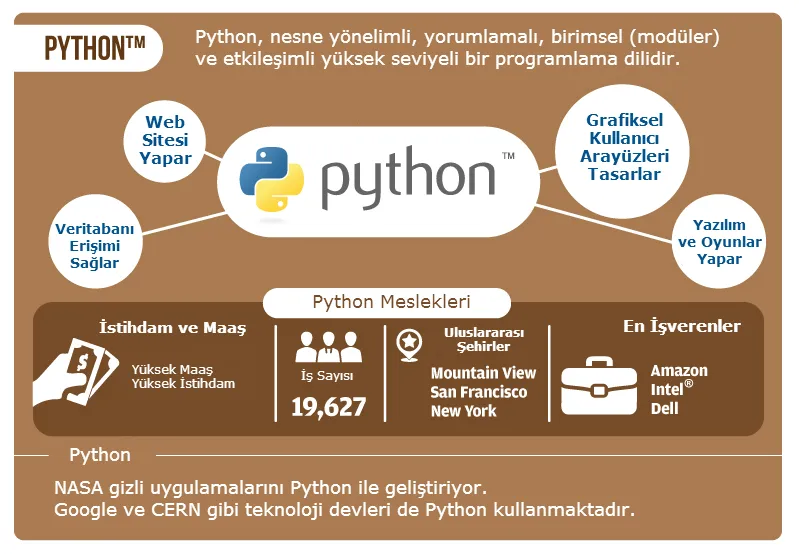

Python veri analizi için neden bu kadar sık tercih edilir?

Python’ın veri analizi dünyasında yaygınlaşmasının birkaç temel nedeni vardır. Öncelikle sözdizimi okunabilir ve anlaşılırdır. Teknik olmayan geçmişe sahip kişiler bile temel veri işlemlerini kısa sürede kavrayabilir. Ayrıca çok geniş bir açık kaynak ekosistemine sahip olduğu için, veri temizleme, istatistik, makine öğrenmesi, görselleştirme ve otomasyon gibi birçok farklı ihtiyacı aynı dil içinde karşılayabilir.

Bir diğer güçlü yön, Python’ın esnekliğidir. Küçük bir raporlama ihtiyacından büyük veri işleme sürecine kadar farklı ölçeklerde kullanılabilir. Veri analistleri, veri mühendisleri, iş analistleri ve veri bilimi ekipleri aynı dili farklı amaçlarla kullanabilir. Bu durum ekipler arasında ortak bir teknik dil kurulmasını kolaylaştırır. Ayrıca Jupyter Notebook gibi araçlar sayesinde analiz süreçleri hem çalıştırılabilir kod hem de açıklama metinleriyle birlikte sunulabilir.

Okunabilir sözdizimiyle hızlı başlamak

Python’ın sade yapısı, ilk kez programlama öğrenen kişiler için avantaj sağlar. Karmaşık sözdizimi yerine daha anlaşılır kod bloklarıyla çalışılır. Bu da analize odaklanmayı kolaylaştırır. Veriyle çalışan ekipler için teknoloji öğrenme süreci ne kadar akıcıysa, üretkenliğe geçiş de o kadar hızlı olur.

Geniş kütüphane desteği sunmak

Pandas, NumPy, Matplotlib, Seaborn, SciPy, scikit-learn ve Plotly gibi araçlar Python ekosisteminin veri tarafında neden güçlü olduğunu açıkça gösterir. Her araç farklı bir probleme odaklanır ve birlikte kullanıldığında kapsamlı bir analiz ortamı oluşur. Bu ekosistem, Python’ı yalnızca bir dil değil, aynı zamanda bir veri bilimi platformu haline getirir.

Python ile veri analizinde en çok kullanılan araçlar nelerdir?

Python veri analizi denildiğinde akla ilk gelen araç genellikle Pandas olur. Bunun nedeni, tablo biçimindeki veriler üzerinde çalışmayı oldukça pratik hale getirmesidir. Ancak güçlü bir analiz akışı tek bir araçla sınırlı değildir. Veri yapısına, hedefe ve çıktı beklentisine göre farklı kütüphaneler birlikte kullanılır. Bazıları veri temizleme için, bazıları görselleştirme için, bazıları ise istatistiksel modelleme için öne çıkar.

Bu araçların birlikte kullanılması, veri işleme sürecini daha sistemli hale getirir. Örneğin bir CSV dosyası Pandas ile okunur, sayısal hesaplamalar NumPy ile desteklenir, grafikler Matplotlib veya Seaborn ile hazırlanır, daha ileri modelleme gerekiyorsa scikit-learn sürece dâhil edilir. Bu katmanlı yapı, Python’ı pratik ve ölçeklenebilir kılar.

Pandas ile tablo odaklı veri işlemek

Pandas, satır ve sütun mantığıyla çalışan veri setlerinde en çok kullanılan araçlardan biridir. Filtreleme, gruplama, birleştirme, eksik veri yönetimi, tarih dönüştürme ve özet tablo çıkarma gibi işlemler bu kütüphane ile verimli biçimde yapılabilir. Özellikle Excel mantığına yakın düşünen kullanıcılar için öğrenmesi oldukça faydalıdır.

NumPy ile sayısal işlemleri hızlandırmak

NumPy, büyük sayısal diziler üzerinde verimli hesaplamalar yapmak için kullanılır. İstatistiksel özetler, matris işlemleri ve performans gerektiren sayısal dönüşümler bu kütüphane ile hız kazanır. Pandas’ın arka planda NumPy ile yakın çalışması da bu aracı önemli kılar.

Matplotlib ve Seaborn ile veriyi görünür kılmak

Bir veri setini anlamanın en etkili yollarından biri görselleştirmedir. Çizgi grafikler, çubuk grafikler, dağılım grafikleri ve yoğunluk dağılımları ilişkileri daha net görmeyi sağlar. Veri görselleştirme, yalnızca sunum için değil; analiz sırasında aykırı değerleri, eğilimleri ve dengesizlikleri keşfetmek için de kritik rol oynar.

- Pandas: Veri temizleme ve tablo işlemleri

- NumPy: Sayısal hesaplamalar ve dizi işlemleri

- Matplotlib: Temel grafik üretimi

- Seaborn: Daha zengin istatistiksel görselleştirmeler

- scikit-learn: Modelleme ve makine öğrenmesi hazırlıkları

- Jupyter Notebook: Etkileşimli analiz ve dokümantasyon

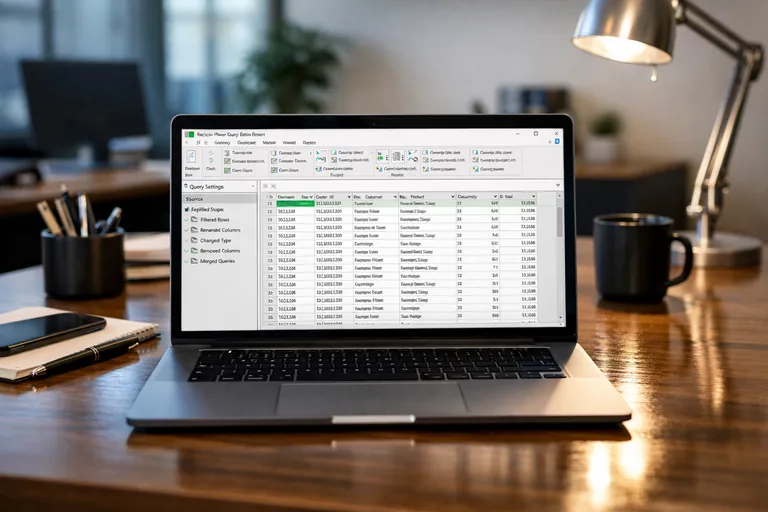

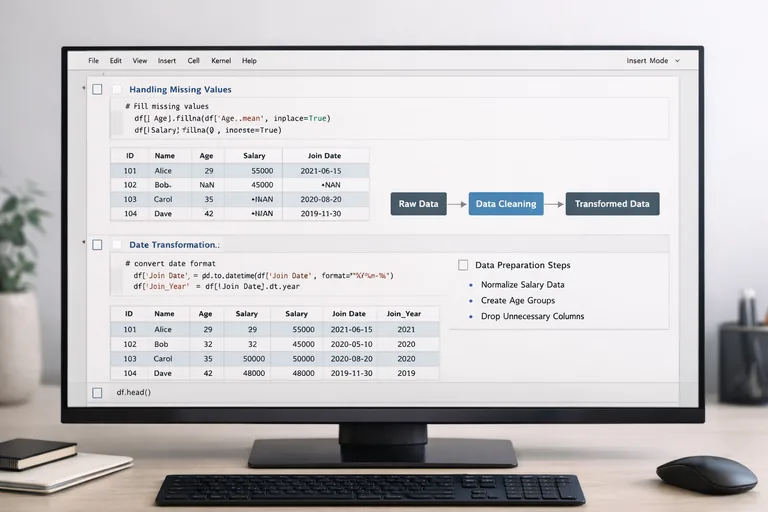

Veri temizleme ve hazırlama neden analiz sürecinin merkezindedir?

Birçok kişi veri analizini doğrudan grafik üretmek veya tahmin modeli kurmak olarak düşünür. Oysa gerçek projelerde zamanın büyük bölümü veri temizleme ve hazırlama aşamasında geçer. Çünkü ham veri çoğu zaman eksik, dağınık veya çelişkili durumdadır. Tarih alanları karışık yazılmış olabilir, metin kolonlarında gereksiz boşluklar bulunabilir, bazı satırlar yinelenmiş olabilir ya da sayısal olması gereken alanlar metin olarak kaydedilmiş olabilir.

Bu sorunlar çözülmeden yapılan analizler yanıltıcı sonuç üretir. Python burada çok güçlü bir avantaj sunar. Temizleme adımları kod olarak tanımlandığında, aynı veri işleme mantığı farklı dosyalarda tekrar kullanılabilir. Böylece ekipler tek seferlik manuel düzenleme yerine standartlaştırılmış veri hazırlama süreçleri kurar. Bu yaklaşım doğruluk kadar hız açısından da önemlidir.

Eksik ve hatalı kayıtları yönetmek

Eksik veriyi yok saymak çoğu zaman doğru yaklaşım değildir. Önce eksikliğin neden oluştuğunu anlamak gerekir. Bazı durumlarda satırı silmek mantıklı olabilir, bazı durumlarda ortalama ya da medyan ile doldurmak daha doğru olabilir. Hatalı değerleri tespit etmek de benzer şekilde dikkat ister; aksi halde analiz çıktısı güvenilirliğini kaybeder.

Veri tiplerini standart hale getirmek

Bir kolonun tarih, sayı veya kategori olarak doğru tanımlanması birçok işlemi doğrudan etkiler. Yanlış veri tipi, filtreleme ve hesaplama adımlarında hata üretebilir. Python ile veri hazırlama çalışmaları, bu tip sorunları sistemli biçimde ortadan kaldırmaya yardımcı olur ve analizi daha sağlam bir zemine taşır.

import pandas as pd

df = pd.read_csv("satislar.csv")

df["tarih"] = pd.to_datetime(df["tarih"], errors="coerce")

df["tutar"] = pd.to_numeric(df["tutar"], errors="coerce")

df = df.drop_duplicates()

df = df.dropna(subset=["musteri_id", "tutar"])

aylik_ozet = df.groupby(df["tarih"].dt.to_period("M"))["tutar"].sum()

print(aylik_ozet)Bu örnek, bir satış dosyasının okunması, tarih ve tutar alanlarının dönüştürülmesi, tekrar eden satırların kaldırılması ve eksik kritik kayıtların ayıklanması gibi temel veri hazırlama adımlarını gösterir. Gerçek hayatta bunun çok daha detaylı versiyonları kullanılır; ancak mantık çoğu zaman benzerdir.

Keşifsel veri analizi iş kararlarını nasıl destekler?

Keşifsel veri analizi, veri setini model kurmadan veya nihai raporu üretmeden önce anlamaya yönelik sistematik inceleme sürecidir. Bu aşamada temel istatistikler hesaplanır, dağılımlar incelenir, ilişkiler görselleştirilir ve beklenmeyen örüntüler aranır. Amaç yalnızca “ne oldu?” sorusunu yanıtlamak değil; aynı zamanda “neden olmuş olabilir?” sorusuna yaklaşmaktır.

Örneğin bir e-ticaret veri setinde belirli ürün kategorilerinin bazı dönemlerde neden daha fazla satıldığını anlamak, müşteri segmentlerinin sepet büyüklüğünü karşılaştırmak veya kampanya etkisini bölgesel bazda incelemek keşifsel veri analizinin parçasıdır. Bu süreç, daha ileri istatistiksel çalışma veya modelleme yapılacaksa hazırlık işlevi de görür.

Descriptive statistics ile genel tabloyu görmek

Ortalama, medyan, standart sapma, minimum ve maksimum değerler tek başına yeterli olmasa da veri seti hakkında ilk resmi verir. Bu özetler, veri dağılımının normal mi çarpık mı olduğunu, aykırı gözlemler bulunup bulunmadığını ve hangi alanların daha derin incelenmesi gerektiğini gösterir.

Korelasyon ve segment bazlı inceleme yapmak

İki değişken arasındaki ilişkiyi anlamak, analiz kalitesini artırır. Fiyat ile satış adedi, ziyaret süresi ile dönüşüm oranı veya kategori ile sepet tutarı arasındaki ilişkiler anlamlı içgörüler üretebilir. Ancak burada dikkat edilmesi gereken şey, korelasyonun tek başına nedensellik anlamına gelmediğidir. Yorumlama aşaması her zaman bağlamla desteklenmelidir.

import seaborn as sns

import matplotlib.pyplot as plt

korelasyon = df[["tutar", "adet", "indirim_orani"]].corr()

print(korelasyon)

sns.scatterplot(data=df, x="indirim_orani", y="tutar")

plt.title("İndirim Oranı ve Tutar İlişkisi")

plt.show()Bu örnek, veri setindeki bazı sayısal alanlar arasındaki ilişkiyi hızlıca görmek için kullanılabilir. Korelasyon matrisi genel yakınlığı gösterirken, dağılım grafiği olası kümelenmeleri veya aykırı davranışları daha görünür hale getirir.

Veri görselleştirme neden yalnızca sunum aracı değildir?

Birçok ekip veri görselleştirmeyi yalnızca yönetime sunum yapılırken kullanılan estetik bir katman gibi düşünür. Oysa doğru grafikler, analiz sürecinin kendisini hızlandırır. Bir dağılım grafiği aykırı değerleri fark ettirebilir, kutu grafik veri dağılımının dengesiz olduğunu gösterebilir, zaman serisi grafiği mevsimselliği ortaya çıkarabilir. Bu nedenle görselleştirme, yalnızca son adım değil, keşif ve doğrulama aşamalarının da önemli bir parçasıdır.

Python bu konuda hem temel hem ileri düzey araçlar sunar. Matplotlib ile özelleştirilebilir grafikler hazırlanabilir, Seaborn ile istatistiksel anlatımı güçlü grafikler üretilebilir, Plotly ile etkileşimli paneller oluşturulabilir. Böylece veri yalnızca sayı tablosu olmaktan çıkar; kararları destekleyen anlamlı bir yapıya dönüşür.

Doğru grafik tipini seçmek

Her veri için aynı grafik uygun değildir. Zaman içindeki değişim için çizgi grafik, kategorik karşılaştırmalar için çubuk grafik, iki değişken ilişkisi için dağılım grafiği tercih edilebilir. Yanlış grafik seçimi doğru veriyi bile yanlış yorumlatabilir. Bu yüzden görselleştirme bilgi tasarımı açısından da düşünülmelidir.

Karar vericiler için anlaşılır çıktı üretmek

Teknik ekiplerin gördüğü ayrıntılar ile yöneticilerin ihtiyaç duyduğu özetler aynı değildir. Başarılı veri analizi, teknik doğruluğu korurken sonuçları anlaşılır biçimde sunabilmelidir. Analitik düşünme kadar anlatım gücü de burada önem taşır. Grafikler, doğru kullanıldığında karmaşık veriyi sadeleştiren güçlü araçlardır.

Python veri analizi ile otomasyon nasıl sağlanır?

Veri analizi çalışmalarının önemli bir bölümü tekrar eden görevlerden oluşur. Her sabah benzer raporları yenilemek, aynı klasördeki dosyaları birleştirmek, belirli kurallara göre veriyi temizlemek veya belli eşikler aşıldığında uyarı üretmek sık karşılaşılan ihtiyaçlardır. Bu görevler manuel yürütüldüğünde hem zaman kaybı hem de hata riski artar. Python ise bu işlemleri otomatik hale getirerek analiz süreçlerini daha verimli kılar.

Örneğin bir klasörde biriken günlük satış dosyalarını otomatik okuyup tek tabloda birleştirmek, haftalık KPI özetini hazırlamak veya belirli iş kurallarına göre veri kalitesi kontrolü yapmak Python ile rahatlıkla otomatikleştirilebilir. Bu yaklaşım, analistlerin zamanını veri taşıma gibi tekrar eden işlerden alıp yorumlama ve iyileştirme gibi daha değerli alanlara yönlendirir.

Rutin raporlama adımlarını kodlaştırmak

Elle yapılan raporlar genellikle kişiye bağımlıdır. Dosya yolu değiştiğinde, kolon adı farklı yazıldığında veya ek veri geldiğinde süreç bozulabilir. Kodla tanımlanmış akışlar ise daha kontrollü ilerler. Böylece aynı mantık farklı dönemlerde ve farklı dosyalarda güvenilir biçimde çalıştırılır.

Veri kalitesi kontrollerini standartlaştırmak

Belirli kolonlarda boşluk oranı artmış mı, kayıt sayısı beklenenden düşük mü, kritik alanda negatif değer gelmiş mi gibi kontroller otomatikleştirilebilir. Bu sayede sorunlar analiz sonrasında değil, veri daha sisteme girerken fark edilir. Bu yaklaşım özellikle veri kalitesi yönetiminde önemli fark yaratır.

Python ile veri analizi öğrenmek isteyenler hangi becerilere odaklanmalı?

Python ile veri analizi öğrenmek isteyen kişilerin yalnızca kütüphane komutlarını ezberlemesi yeterli değildir. Önce verinin yapısını anlamayı, tablo mantığıyla düşünmeyi ve iş sorusunu teknik probleme çevirmeyi öğrenmek gerekir. Çünkü iyi analiz, yalnızca doğru kodu çalıştırmak değil; doğru soruyu sormakla başlar. Bu nedenle iş problemi, metrik tanımı ve bağlam bilgisi teknik beceriler kadar önemlidir.

Temel Python bilgisi, veri tipleri, döngüler, fonksiyonlar ve dosya okuma gibi konular başlangıç için gereklidir. Sonrasında Pandas ile veri işleme, NumPy ile sayısal işlemler, veri görselleştirme araçları ve temel istatistik bilgisi devreye girer. Daha sistemli ve uygulama odaklı bir öğrenme yolu izlemek isteyenler için python veri analizi eğitimi iyi bir başlangıç noktası olabilir.

İş problemini veri problemine çevirmek

“Satış neden düştü?” sorusu tek başına teknik bir talep değildir. Bunun veri açısından hangi kırılımlarda inceleneceği, hangi dönemlerle karşılaştırılacağı ve hangi metriklerin esas alınacağı belirlenmelidir. Bu düşünme biçimi geliştiğinde, kullanılan araçlar çok daha etkili sonuç üretir.

Temel istatistik ve yorumlama becerisi geliştirmek

Ortalama, varyans, dağılım, örneklem ve korelasyon gibi kavramlar veri analizi için vazgeçilmezdir. Çünkü kod bir sonuç üretse bile, o sonucu doğru yorumlayamıyorsanız analiz eksik kalır. Teknik araç bilgisi ile analitik yorumlama becerisinin birlikte gelişmesi gerekir.

Veri bilimi araçları ile veri analizi arasındaki ilişki nasıl kurulmalı?

Veri analizi ve veri bilimi her zaman aynı şey değildir; ancak birbirine güçlü biçimde bağlıdır. Veri analizi daha çok mevcut veriyi anlama, raporlama ve içgörü üretme odaklıyken; veri bilimi bu sürece modelleme, tahminleme ve daha ileri istatistiksel yaklaşımlar ekleyebilir. Python ise bu iki alan arasında doğal bir köprü görevi görür.

Bu yüzden veri analizi öğrenen bir ekip, zamanla veri bilimi araçlarına geçiş yapmakta zorlanmaz. Aynı ekosistem içinde veri temizleme, özellik üretimi, model hazırlığı ve performans değerlendirmesi yapılabilir. Böylece gelişim çizgisi kopuk değil, birbirini tamamlayan bir yol halinde ilerler.

- Veriyi doğru okumak ve temizlemek

- Soruyu ölçülebilir analitik hedefe dönüştürmek

- Uygun Python araçlarını seçmek

- Grafik ve özetlerle sonuçları görünür kılmak

- Gerekirse modeli destekleyecek hazırlık adımlarını kurmak

Sonuç olarak Python ile veri analizi, sayısal veriyi anlamlandırmanın ötesinde; iş süreçlerini daha görünür, ölçülebilir ve geliştirilebilir hale getiren güçlü bir çalışma biçimidir. Pandas, NumPy, Matplotlib, Seaborn ve Jupyter Notebook gibi araçlar bu süreci hem teknik hem pratik açıdan destekler. Veri temizleme, keşifsel analiz, görselleştirme ve otomasyon bir araya geldiğinde Python yalnızca bir programlama dili olmaktan çıkar; karar kalitesini artıran kapsamlı bir çalışma ortamına dönüşür. Veriye dayalı düşünme kültürünü güçlendirmek isteyen ekipler için Python bilgisi bugün artık önemli bir avantaj değil, birçok durumda temel gereksinimdir.